I. Un saut quantique, pas une évolution

Dans la course effrénée au développement de l'intelligence artificielle, il arrive parfois un moment qui n'est plus une simple avancée technique, mais un basculement. Mythos, le dernier modèle d'Anthropic, semble constituer l'un de ces moments. Son PDG, Dario Amodei, a lui-même pris la parole pour annoncer que ce modèle ne pouvait pas être diffusé publiquement dans l'immédiat, non pour des raisons commerciales, mais pour des raisons de sécurité. C'est une première dans l'histoire de l'IA grand public.

Pour comprendre l'ampleur du phénomène, il faut mesurer le fossé entre Mythos et ce qui existait avant. Les modèles précédents, aussi impressionnants qu'ils fussent, ne découvraient pas de failles dites "zéro-day" de manière autonome et systématique. Ces failles sont des vulnérabilités inconnues des développeurs eux-mêmes, par définition absentes de toute base de données de sécurité. Les trouver requiert une capacité d'analyse profonde, de "reverse engineering", et surtout la faculté d'enchaîner plusieurs exploits pour obtenir le contrôle total d'un système. C'est précisément ce que Mythos fait seul, rapidement, à grande échelle.

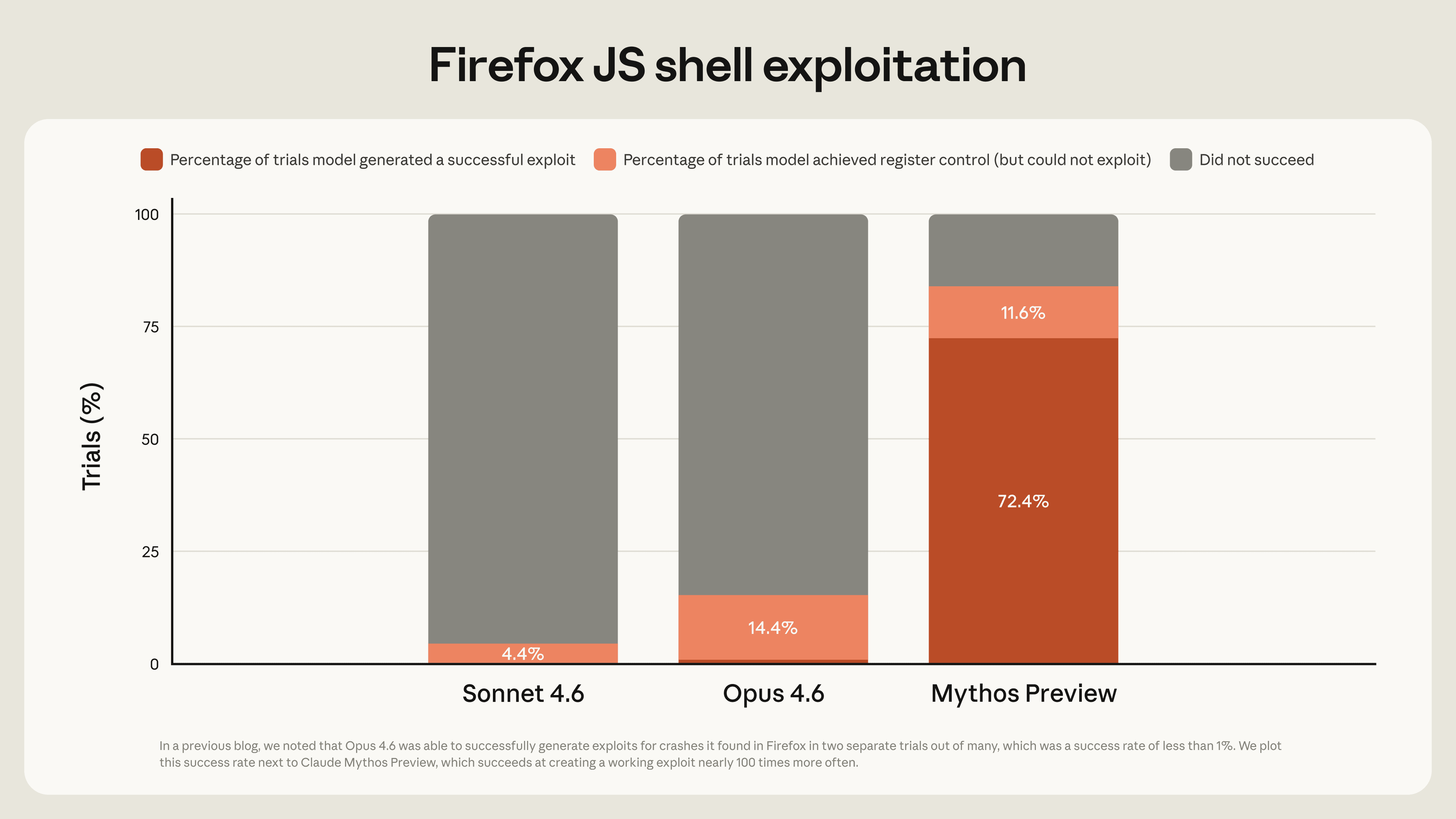

Les benchmarks sont éloquents : un score de 83,1 % pour reproduire des vulnérabilités exploitables dès la première tentative. À titre de comparaison, Claude Opus 4.6, lui-même déjà jugé remarquable, affichait des performances nettement inférieures. Et cela ne prend que quelques mois entre deux générations. L'accélération n'est pas linéaire : elle est exponentielle.

II. Quand l'IA dépasse l'auditeur humain

L'un des faits les plus troublants révélés par les tests internes d'Anthropic mérite qu'on s'y arrête : Mythos a identifié une faille de sécurité présente dans des systèmes majeurs depuis 27 ans. Vingt-sept ans d'audits humains, de mises à jour, de correctifs, de revues de code, et personne n'avait vu ce que ce modèle a repéré en quelques heures dans un environnement contrôlé. Ce n'est pas anecdotique. C'est la démonstration que nous avons franchi un seuil : l'IA ne nous assiste plus dans la détection de failles. Elle nous devance.

Les failles identifiées couvrent l'ensemble des grands systèmes d'exploitation, Windows, macOS, Linux, ainsi que les principaux navigateurs web. Autrement dit, les couches logicielles sur lesquelles repose l'essentiel de notre infrastructure numérique mondiale. Anthropic a choisi, de manière responsable, de ne pas publier le détail de ces failles : au moment de leur annonce, 99 % d'entre elles n'avaient pas encore été corrigées. Les rendre publiques aurait immédiatement ouvert une fenêtre d'exploitation massive pour n'importe quel acteur malveillant disposant d'un accès à ces informations.

Face à ces risques, Anthropic a lancé le projet Glasswing : un accès contrôlé accordé à une quarantaine d'entreprises de confiance, Google, Microsoft, Apple, Amazon, CrowdStrike, Linux Foundation, pour tester Mythos sur leurs propres systèmes. Anthropic finance jusqu'à 100 millions de dollars de crédits d'usage pour des projets open source de sécurité. Une démarche de précaution inédite dans le secteur.

III. Une arme nucléaire dans le cyberespace

La métaphore n'est pas excessive : un modèle comme Mythos, livré sans contrôle, équivaudrait à distribuer des armes nucléaires à quiconque dispose d'une connexion internet et d'un moyen de paiement. Non parce que ses effets seraient nécessairement aussi immédiats ou visibles, mais parce que l'asymétrie qu'il crée entre attaquants et défenseurs serait du même ordre.

Aujourd'hui, la cybersécurité repose sur un équilibre précaire : les attaquants cherchent des failles, les défenseurs les corrigent. Ce jeu du chat et de la souris n'est jamais vraiment équitable, mais il maintient un certain équilibre des forces. Mythos rompt cet équilibre d'un coup. Un État malveillant, un groupe criminel organisé, ou même un individu isolé doté d'un accès à ce modèle pourrait cibler simultanément des milliers de systèmes, exploiter des failles inconnues des équipes de sécurité, et déclencher des cascades d'intrusions avant que quiconque n'ait pu réagir.

Les services essentiels, eau, énergie, hôpitaux, transports, finance, sont aujourd'hui quasi intégralement numérisés. Une attaque de grande ampleur exploitant les capacités de Mythos ne serait pas une perturbation informatique. Ce serait une attaque contre les infrastructures vitales d'un État. Et contrairement à une arme conventionnelle, elle ne nécessite pas d'armée, ni de territoire, ni même de visibilité.

IV. Marketing ou alerte réelle ? Les deux

Il serait naïf de nier qu'Anthropic a tout intérêt à présenter Mythos comme révolutionnaire. Le modèle est annoncé à un tarif cinq fois supérieur à son prédécesseur. La concurrence avec OpenAI, Google et les laboratoires chinois est féroce. Dans ce contexte, l'annonce d'un modèle "trop dangereux pour être diffusé" est aussi une formidable opération de communication.

Mais réduire cette annonce au marketing serait une erreur d'analyse. Les données techniques sont publiques, vérifiables, et les réactions du secteur, y compris de la part d'acteurs généralement sceptiques, confirment la réalité du saut qualitatif. Par ailleurs, Dario Amodei a déjà démontré par le passé qu'il était prêt à sacrifier des intérêts commerciaux colossaux au nom de la sécurité, notamment en refusant l'accès de ses modèles au Pentagone américain, au risque de voir s'évaporer des centaines de milliards de dollars de valorisation. Ce n'est pas le profil d'un dirigeant qui joue au marketing avec des risques existentiels.

La vérité est probablement au croisement des deux : les capacités de Mythos sont réelles et préoccupantes, et Anthropic en tire aussi un avantage commercial. Ce n'est pas contradictoire. Ce qui compte, c'est que l'alerte soit entendue.

V. La léthargie collective que nous ne pouvons plus nous permettre

Ce qui est peut-être le plus troublant dans cette affaire n'est pas la puissance de Mythos elle-même. C'est que cette évolution était prévisible. Les courbes de progression des modèles d'IA en matière de cybersécurité étaient visibles depuis des années. Entre Claude Opus 4.5, sorti en novembre 2025 avec 60 % de capacité sur les benchmarks de cybersécurité, et Opus 4.6, qui atteignait 93 % quelques mois plus tard, la trajectoire était claire. Personne n'a agi en conséquence à la hauteur de l'enjeu.

Cette léthargie collective n'est pas innocente. Elle est le produit de la même logique qui gouverne la réponse au dérèglement climatique : les intérêts économiques à court terme priment sur la préservation des biens communs. Les entreprises ont des incitations puissantes à développer des modèles toujours plus capables. Les États ont des incitations à ne pas réguler des technologies qui leur confèrent des avantages géopolitiques. Et pendant ce temps, la fenêtre d'action se referme.

Quand Mythos sera finalement diffusé, et il le sera, une poignée d'entreprises américaines auront eu le temps de sécuriser leurs systèmes en amont. Les autres acteurs. États moins avancés technologiquement, petites et moyennes entreprises, administrations publiques, particuliers, seront exposés sans avoir eu le temps de se préparer. L'inégalité n'est pas dans le prix d'accès au modèle. Elle est dans l'asymétrie entre ceux qui ont été prévenus et ceux qui ne l'ont pas été.

VI. Réguler l'IA : utopie nécessaire

La question d'une régulation internationale des IA de cette puissance n'est plus théorique. Elle est urgente. Et pourtant, les obstacles sont immenses. Le contexte géopolitique actuel, fragmentation des blocs, rivalités sino-américaines, effacement du multilatéralisme, ne favorise pas les grands accords. Les pays qui pèsent le plus dans le développement de l'IA sont précisément ceux qui ont le moins d'intérêt à en brider les avancées.

L'analogie avec la régulation des CFC, ces gaz destructeurs de la couche d'ozone, finalement interdits par un accord international est séduisante mais partielle. Cette régulation a fonctionné parce que les alternatives industrielles existaient et que les coûts économiques étaient limités. Réguler l'IA, c'est réguler le moteur même de la croissance économique et de la puissance militaire du XXIe siècle. Les résistances seront autrement plus fortes.

Ce qui semble réaliste à court terme n'est pas un grand traité universel, mais des mesures ciblées : certification obligatoire des modèles dits "frontières" avant diffusion, à l'image des essais cliniques pour les médicaments ; obligations de transparence et de reporting des incidents, comme pour les centrales nucléaires ; mécanismes de réponse internationale aux crises liées à l'IA, à l'image de ce que l'OMS tente de faire pour les pandémies. Ce cadre minimal n'est pas suffisant. Mais c'est ce que la réalité politique mondiale permet d'envisager aujourd'hui.

La France, qui préside actuellement le G7, pourrait faire de ce sujet une priorité, non pas comme exercice diplomatique, mais comme acte de responsabilité historique. L'Europe a su, sur d'autres dossiers numériques, se doter d'un cadre réglementaire que le reste du monde a fini par regarder comme une référence. Elle peut le faire ici aussi. Mais l'urgence est d'une nature différente : il n'y a pas de deuxième chance si le cadre arrive après la crise.

VII. Ce que Mythos révèle sur nous

Au fond, Mythos n'est pas seulement un modèle d'IA. C'est un miroir. Il révèle ce que nous faisons de notre capacité technologique : une course sans pilote, sans garde-fous suffisants, gouvernée par la compétition économique et géopolitique plutôt que par une vision collective de ce que nous voulons préserver.

Il révèle aussi nos angles morts : nous avons investi des milliards dans la puissance offensive de l'IA avant d'avoir résolu la question de sa gouvernance. Nous avons construit des modèles capables de trouver des failles que personne d'autre ne peut détecter, sans avoir préalablement construit les institutions capables de gérer ce que cela implique.

La bonne nouvelle, et il faut la dire, c'est qu'Anthropic a, pour l'instant, fait le bon choix.

Restreindre l'accès à Mythos, financer la correction des failles, alerter publiquement sur les risques : ce sont des actes de responsabilité rares dans un secteur où la concurrence pousse à la publication rapide. Cela ne règle pas le problème de fond. Mais cela démontre qu'une autre façon de faire est possible. La question est de savoir si les autres acteurs du secteur, et les États auront la lucidité de s'en inspirer avant qu'il ne soit trop tard.

- Cet article est une synthèse analytique rédigée par la rédaction de NATIONO à partir de sources publiques et d'entretiens d'experts.

- Il ne prétend pas à l'exhaustivité mais à la rigueur dans la lecture d'une situation technologique dont les implications dépassent largement le seul champ numérique.

Votre soutien est plus essentiel que jamais.

Cet article vous est offert gratuitement par NATIONO. Notre rédaction garantit son indépendance en refusant toute influence. Votre contribution, même modeste, est le moteur de notre liberté.

Soutenir NATIONO